सोचिए ज़रा—एक सुबह आप उठते हैं, फोन खोलते हैं… और किसी दोस्त का मैसेज आता है, “ये तुम हो क्या?” आप लिंक खोलते हैं… और दिल धक से रह जाता है। स्क्रीन पर आपका चेहरा है, आपकी आवाज़ है, लेकिन वो आप नहीं हैं। कुछ ऐसा कहा जा रहा है, कुछ ऐसा किया जा रहा है, जो आपने कभी सोचा भी नहीं। यही है Deepfake की दुनिया—जहाँ सच और झूठ के बीच की लाइन almost invisible हो चुकी है। और सबसे डरावनी बात? अगला शिकार… आप भी हो सकते हैं।

आज का डिजिटल जमाना हमें ताकत देता है—reach, recognition, revenue—but साथ ही एक ऐसा खतरा भी देता है, जिसके लिए हम mentally तैयार नहीं हैं। पहले वीडियो लीक होते थे, अब वीडियो बनाए जाते हैं। पहले तस्वीरें चुराई जाती थीं, अब पहचान चुराई जाती है। Deepfake सिर्फ technology नहीं है, ये trust पर हमला है, reputation पर वार है, और कई बार ज़िंदगी भर का trauma बन जाता है। इस वीडियो में हम डर फैलाने नहीं आए हैं, बल्कि आपको empower करने आए हैं—ताकि अगर Deepfake आए, तो आप टूटें नहीं… बल्कि मुकाबला करें।

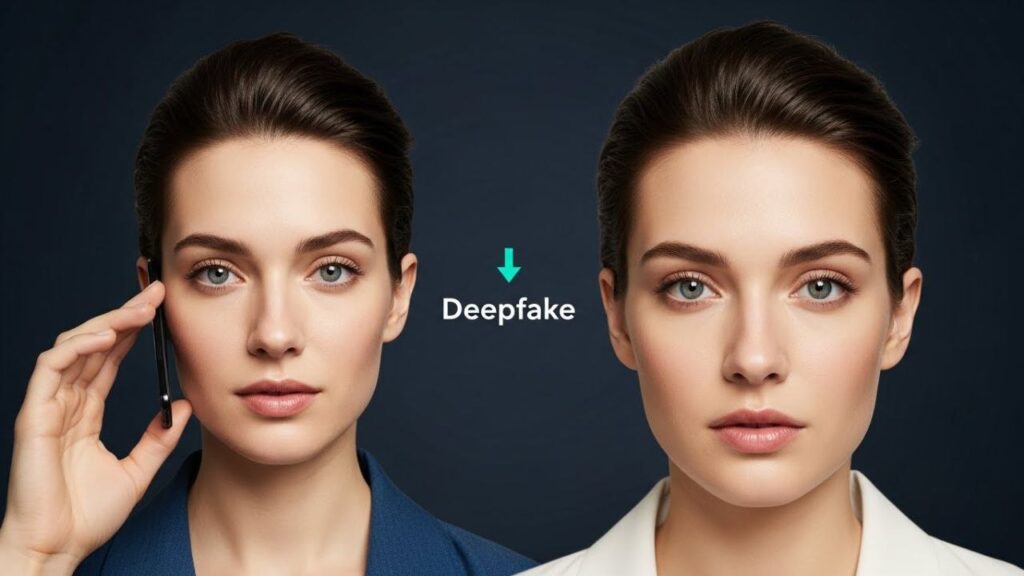

Deepfake क्या है, इसे technical language में समझना ज़रूरी नहीं, इसे effect के level पर समझना ज़रूरी है। A I आपकी photos, videos, voice samples को उठाता है—जो आपने social media पर कभी casually डाले थे—और उनसे एक नया video बना देता है। ऐसा video जो दिखने में real लगता है, सुनने में real लगता है, और देखने वाले को convince कर देता है कि “हाँ, यही सच है।” यही वजह है कि आज fake video से blackmail हुआ है, fake audio से पैसे ठगे गए हैं, fake बयान से careers खत्म हुए हैं, और fake clips से रिश्ते टूटे हैं।

सबसे dangerous बात ये है कि Deepfake अब सिर्फ celebrities तक सीमित नहीं रहा। पहले targets बड़े लोग थे—actors, politicians, influencers। लेकिन अब A I tools इतने cheap और accessible हो गए हैं कि एक common आदमी, एक student, एक housewife, एक government employee—कोई भी target बन सकता है। क्योंकि attacker को fame नहीं चाहिए, उसे सिर्फ आपके डर की कीमत चाहिए। कभी पैसे के रूप में, कभी चुप्पी के रूप में, और कभी आपकी इज्ज़त के बदले।

अब सवाल ये है—क्या Deepfake को पहचाना जा सकता है? जवाब है—हाँ, लेकिन ध्यान से। Social media पर viral कोई भी video, खासकर जिसमें पैसे, sex, politics, या shocking statements हों—उस पर तुरंत भरोसा करना खुद को invite करना है trouble के लिए। Deepfake videos में अक्सर बहुत subtle गड़बड़ियाँ होती हैं। Lips की movement audio से perfectly sync नहीं होती। Eyes blink करना भूल जाती हैं या unnatural तरीके से blink करती हैं। Skin texture कभी ज़्यादा smooth, कभी patchy लगता है। Background light चेहरे से match नहीं करती। ये flaws बहुत छोटे होते हैं, लेकिन अगर आप alert हैं, तो पकड़ में आ जाते हैं।

कई बार voice भी betray कर जाती है। Deepfake audio में emotions flat हो सकते हैं। Natural pauses missing होते हैं। Accent थोड़ा सा off लगता है—जैसे कोई आपको imitate कर रहा हो, लेकिन पूरी तरह copy न कर पा रहा हो। यही जगह है जहाँ common sense आपकी सबसे बड़ी security बनती है। अगर video या audio में message ऐसा है जो आपके behavior से match नहीं करता—तो रुकिए। Panic मत कीजिए। Verify कीजिए।

Verification आज survival skill बन चुकी है। एक simple सा rule याद रखिए—“देखा मतलब सच नहीं।” अगर कोई वीडियो suspicious लगे, तो उसका एक frame निकालिए, और reverse image search कीजिए। कई बार पता चल जाता है कि वही image पहले किसी और context में इस्तेमाल हो चुकी है। अलग-अलग A I detection tools भी हैं, जो video के patterns, audio waveform और metadata analyze करके संकेत देते हैं कि content manipulated हो सकता है। एक tool पर भरोसा मत कीजिए—multiple checks हमेशा safer होते हैं।

लेकिन पहचान से भी ज़्यादा ज़रूरी है prevention। क्योंकि Deepfake का सबसे बड़ा fuel है—आपका digital footprint। जितनी ज़्यादा आपकी photos, videos, reels, voice notes public हैं, उतना ज़्यादा raw material attacker के पास है। इसका मतलब ये नहीं कि आप internet छोड़ दें, बल्कि smart use करें। Social media पर हर photo public होना ज़रूरी नहीं। हर reel permanent होनी ज़रूरी नहीं। Privacy settings कोई formality नहीं हैं—ये आपकी digital boundaries हैं।

Profile private रखना weakness नहीं है, wisdom है। Unknown friend requests accept करना curiosity नहीं, risk है। Two-factor authentication सिर्फ extra step नहीं, extra shield है। Phone और laptop को update रखना boring लगता है, लेकिन यही boring updates आपको exciting problems से बचाते हैं। Suspicious links, free giveaways, miracle job offers—अगर ये सब video के साथ आएँ, तो double alert हो जाइए। Deepfake scams अक्सर urgency create करते हैं—“अभी करो, वरना नुकसान हो जाएगा।” यहीं आपको slow होना है।

अब सबसे sensitive सवाल—अगर Deepfake बन ही जाए तो? सबसे पहले—panic मत कीजिए। Panic attacker की सबसे बड़ी जीत होती है। तुरंत evidence secure कीजिए। Screenshots, video links, URLs, date-time—सब कुछ save कीजिए। ये emotional काम नहीं है, ये legal तैयारी है। उसके बाद platform पर report कीजिए। Social media companies अब Deepfake और impersonation को seriously लेती हैं, लेकिन उन्हें proof चाहिए—जो आपके पास होना चाहिए।

इसके बाद cyber crime complaint दर्ज कराना ज़रूरी है। बहुत से लोग ये सोचकर रुक जाते हैं कि “लोग क्या कहेंगे?” लेकिन याद रखिए—शर्म victim की नहीं, अपराधी की होती है। अगर content defamatory या obscene है, तो legal help लेना कमजोरी नहीं, समझदारी है। Family से बात छुपाने से trauma बढ़ता है, कम नहीं होता। Support system जितना जल्दी activate होगा, recovery उतनी आसान होगी।

Deepfake सिर्फ technology का issue नहीं है, ये psychology का भी game है। Attacker आपको अकेला feel कराना चाहता है, guilty feel कराना चाहता है, और silence खरीदना चाहता है। जैसे ही आप बोलते हैं, report करते हैं, और stand लेते हैं—उसकी power टूटने लगती है। इसलिए याद रखिए—आपकी आवाज़ ही आपका strongest defense है।

अब एक uncomfortable सच—future में Deepfake और better होने वाला है। Videos और real लगेंगे, voices और perfect होंगी। ऐसे में safety का मतलब सिर्फ tools नहीं होगा, mindset होगा। Skeptical mindset। Verify-first mindset। Emotional reaction से पहले logical pause। यही habits आपको future-proof बनाती हैं।

आप government service में हों, private job में हों, student हों या creator—एक बात सबके लिए common है: आपकी identity आपकी सबसे बड़ी asset है। और Deepfake उसी asset पर हमला करता है। इसलिए digital दुनिया में जितना visible होना ज़रूरी है, उतना ही protected होना भी ज़रूरी है।

इस वीडियो का मकसद डर पैदा करना नहीं, clarity देना है। Deepfake अंधेरा है, लेकिन awareness उसकी रोशनी है। Technology का misuse रोका जा सकता है—अगर user powerless न रहे। आज अगर आप ये video देख रहे हैं, तो आप already एक step आगे हैं—क्योंकि informed person, easy victim नहीं होता।

आर्टिकल खत्म करने से पहले एक सवाल खुद से पूछिए—“अगर आज नहीं, तो कल… क्या मैं ready हूँ?” Ready मतलब paranoid नहीं, prepared। Privacy settings check करना, two factor on करना, family को aware करना—ये छोटे steps हैं, लेकिन impact बहुत बड़ा है। Deepfake का era हमें मजबूर कर रहा है कि हम digital दुनिया में सिर्फ users न रहें, guardians बनें—अपनी identity के।

Conclusion

अगर हमारे आर्टिकल ने आपको कुछ नया सिखाया हो, तो इसे शेयर करना न भूलें, ताकि यह महत्वपूर्ण जानकारी और लोगों तक पहुँच सके। आपके सुझाव और सवाल हमारे लिए बेहद अहम हैं, इसलिए उन्हें कमेंट सेक्शन में जरूर साझा करें। आपकी प्रतिक्रियाएं हमें बेहतर बनाने में मदद करती हैं।

GRT Business विभिन्न समाचार एजेंसियों, जनमत और सार्वजनिक स्रोतों से जानकारी लेकर आपके लिए सटीक और सत्यापित कंटेंट प्रस्तुत करने का प्रयास करता है। हालांकि, किसी भी त्रुटि या विवाद के लिए हम जिम्मेदार नहीं हैं। हमारा उद्देश्य आपके ज्ञान को बढ़ाना और आपको सही तथ्यों से अवगत कराना है।

अधिक जानकारी के लिए आप हमारे GRT Business Youtube चैनल पर भी विजिट कर सकते हैं। धन्यवाद!”